(Auszug aus der Pressemitteilung)

Supermicro, Inc. (NASDAQ: SMCI), ein Hersteller von IT-Gesamtlösungen für KI, Cloud, Storage und 5G/Edge, kündigt eines der branchenweit umfangreichsten Portfolios an neuen GPU-Systemen an, die auf der NVIDIA-Referenzarchitektur basieren und den neuesten NVIDIA GH200 Grace Hopper und NVIDIA Grace CPU Superchip enthalten. Die neue modulare Architektur wurde entwickelt, um KI-Infrastruktur und beschleunigtes Computing in kompakten 1 HE- und 2 HE-Formfaktoren zu standardisieren und gleichzeitig ultimative Flexibilität und Erweiterungsmöglichkeiten für aktuelle und zukünftige GPUs, DPUs und CPUs zu bieten. Die fortschrittliche Technologie von Supermicro zur Flüssigkeitskühlung ermöglicht Konfigurationen mit sehr hoher Dichte, wie z. B. eine 1 HE-2-Knoten-Konfiguration mit 2 NVIDIA GH200 Grace Hopper Superchips, die mit einem Hochgeschwindigkeits-Interconnect integriert sind. Supermicro kann Tausende von KI-Servern im Rack-Scale-Format pro Monat aus Einrichtungen auf der ganzen Welt ausliefern und gewährleistet Plug-and-Play-Kompatibilität.

„Supermicro ist ein anerkannter Marktführer, der die heutige KI-Revolution vorantreibt und Rechenzentren so umgestaltet, dass sie das Versprechen von KI für viele Workloads erfüllen“, sagte Charles Liang, Präsident und CEO von Supermicro. „Für uns ist es von entscheidender Bedeutung, Systeme anzubieten, die hochgradig modular, skalierbar und universell für die sich schnell entwickelnden KI-Technologien sind. Die NVIDIA MGX-basierten Lösungen von Supermicro zeigen, dass unsere Bausteinstrategie es uns ermöglicht, die neuesten Systeme schnell auf den Markt zu bringen, und dass sie branchenweit die Workload-optimiertesten sind. Durch die Zusammenarbeit mit NVIDIA tragen wir dazu bei, die Markteinführung neuer KI-fähiger Anwendungen für Unternehmen zu beschleunigen, vereinfachen die Bereitstellung und reduzieren die Umweltbelastung. Die neuen Server sind mit der neuesten, für KI optimierten Technologie ausgestattet, darunter NVIDIA GH200 Grace Hopper Superchips, BlueField und PCIe 5.0 -Steckplätze.“

„NVIDIA und Supermicro arbeiten seit langem gemeinsam an einigen der leistungsstärksten KI-Systeme auf dem Markt“, erklärte Ian Buck, Vice President of Hyperscale and HPC bei NVIDIA. „Das modulare Referenzdesign NVIDIA MGX, kombiniert mit der Serverexpertise von Supermicro, wird neue Generationen von KI-Systemen hervorbringen, die unsere Grace- und Grace Hopper-Superchips enthalten und zum Nutzen von Kunden und Branchen weltweit sein werden.“

Die NVIDIA MGX-Plattform von Supermicro im Überblick

Die NVIDIA MGX-Plattformen von Supermicro wurden entwickelt, um eine Reihe von Servern bereitzustellen, die zukünftige KI-Technologien unterstützen. Diese neue Produktlinie trägt den einzigartigen thermischen, energetischen und mechanischen Herausforderungen von KI-basierten Servern Rechnung.

Die neue NVIDIA MGX-Serverreihe von Supermicro umfasst:

ARS-111GL-NHR: 1 NVIDIA GH200 Grace Hopper Superchip, luftgekühlt

ARS-111GL-NHR-LCC: 1 NVIDIA GH200 Grace Hopper Superchip, flüssigkeitsgekühlt

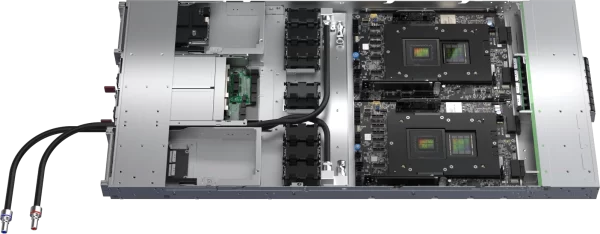

ARS-111GL-DHNR-LCC: 2 NVIDIA GH200 Grace Hopper Superchips, 2 Knoten, flüssigkeitsgekühlt

ARS-121L-DNR: 2 NVIDIA Grace CPU Superchips in jedem der 2 Knoten, insgesamt 288 Kerne

ARS-221GL-NR: 1 NVIDIA Grace CPU Superchip in 2 HE

SYS-221GE-NR: Dual-Sockel Intel Xeon Scalable-Prozessoren der 4. Generation mit bis zu 4 NVIDIA H100 Tensor Core oder 4 NVIDIA PCIe-GPUs

Jede MGX-Plattform kann mit der NVIDIA BlueField®-3 DPU und/oder NVIDIA ConnectX®-7 Interconnects für leistungsstarke InfiniBand- oder Ethernet-Netzwerke erweitert werden.

Technische Spezifikationen

Die 1 HE NVIDIA MGX-Systeme von Supermicro haben bis zu 2 NVIDIA GH200 Grace Hopper Superchips mit 2 NVIDIA H100 GPUs und 2 NVIDIA Grace CPUs. Jedes System verfügt über 480 GB LPDDR5X Speicher für die CPU und 96 GB HBM3 oder 144 GB HBM3e Speicher für die GPU. Das speicherkohärente NVIDIA-C2C mit hoher Bandbreite und niedriger Latenz verbindet CPU, GPU und Speicher mit 900 GBit/s – 7 Mal schneller als PCIe 5.0. Die modulare Architektur bietet mehrere PCIe 5.0 x16 FHFL-Steckplätze zur Aufnahme von DPUs für Cloud- und Datenmanagement sowie Erweiterungsmöglichkeiten für zusätzliche GPUs, Netzwerke und Speicher.

Mit dem 1 HE-2-Knoten-Design mit 2 NVIDIA GH200 Grace Hopper Superchips können die bewährten Direct-to-Chip-Flüssigkeitskühlungslösungen von Supermicro die Betriebskosten um mehr als 40 % senken und gleichzeitig die Rechendichte erhöhen und die Rack-Scale-Implementierung für große Sprachmodell-Cluster (LLM) und HPC-Anwendungen vereinfachen.

Die 2 HE Supermicro NVIDIA MGX-Plattform unterstützt sowohl NVIDIA Grace als auch x86 CPUs mit bis zu 4 Full-Size-GPUs für Rechenzentren, wie z. B. den NVIDIA H100 PCIe, H100 NVL oder L40S. Sie bietet außerdem drei zusätzliche PCIe 5.0 x16-Steckplätze für I/O-Konnektivität und acht Hot-Swap-EDSFF-Speicherschächte.

Supermicro bietet NVIDIA-Netzwerke zur Sicherung und Beschleunigung von KI-Workloads auf der MGX-Plattform. Dazu gehört eine Kombination aus NVIDIA BlueField-3-DPUs, die eine 2x 200 GBit/s-Konnektivität zur Beschleunigung des User-to-Cloud- und Datenspeicherzugriffs bieten, und ConnectX-7-Adaptern, die bis zu 400 GBit/s InfiniBand- oder Ethernet-Konnektivität zwischen GPU-Servern bieten.

Entwickler können diese neuen Systeme und NVIDIA-Softwareangebote schnell für jede Art von Workload in der Branche nutzen. Zu diesen Angeboten gehört NVIDIA AI Enterprise, eine unternehmensfähige Software, die die NVIDIA KI-Plattform unterstützt und die Entwicklung und den Einsatz von produktionsreifen generativen KI-, Computer-Vision-, Sprach-KI- und anderen Anwendungen optimiert. Darüber hinaus bietet das NVIDIA HPC Software Development Kit die notwendigen Tools, die für die Weiterentwicklung des wissenschaftlichen Rechnens benötigt werden.

Jeder Aspekt der Supermicro NVIDIA MGX-Systeme ist auf Steigerung der Effizienz ausgelegt, vom intelligenten thermischen Design bis hin zur Komponentenauswahl. Die NVIDIA Grace Superchip-CPUs verfügen über 144 Kerne und liefern bis zu zweimal mehr Leistung pro Watt im Vergleich zu den heutigen Industriestandard-x86-CPUs. Spezifische Supermicro NVIDIA MGX-Systeme können mit zwei Knoten in 1 HE konfiguriert werden, die insgesamt 288 Kerne auf zwei Grace CPU Superchips haben, um bahnbrechende Rechendichten und Energieeffizienz in Hyperscale- und Edge-Rechenzentren zu bieten.

Neueste Kommentare

5. Juni 2026

31. Mai 2026

28. Mai 2026

16. Mai 2026

12. Mai 2026

29. April 2026